Sesgos automatizados: el riesgo de usar la IA sin perspectiva de género

Daniela Martínez Martínez · 1 de diciembre de 2025

La inteligencia artificial (IA) forma parte de nuestra vida diaria en el uso de mapas de tráfico en tiempo real, la interacción con chatbots y asistentes virtuales, la obtención de resultados cuando tecleamos una palabra en un buscador. Cada vez más empresas la implementan en sus procesos de trabajo; sin embargo, la IA también reproduce estereotipos de género que corren el riesgo de convertirse en sesgos automatizados.

“La tecnología nunca es neutra. Si los seres humanos tenemos sesgos, los pasamos a los sistemas”, señala Tatiana Revilla, especialista en políticas públicas y género.

¿Por qué se replican estos sesgos? Estamos frente a un cambio de paradigma ante la llamada “IA generativa”, es decir, sistemas capaces de imitar la inteligencia humana según los datos con los que fueron entrenados.

Sin embargo, la inteligencia artificial generativa se “entrena” con grandes cantidades de información disponible en internet, así como con la interacción de los usuarios. Así funcionan los modelos de lenguaje de gran tamaño (LLM, por sus siglas en inglés) como ChatGPT y Gemini.

La inteligencia artificial actúa como un espejo que magnifica aspectos de la sociedad, explica Marcela Hernández Oropa, especialista en violencia digital e impulsora de la Ley Olimpia, un conjunto de reformas legales que, sobre todo, reconoce que la difusión de contenido íntimo sin consentimiento es un delito.

Además de reflejar prejuicios existentes, la IA los puede amplificar y normalizar. Los ejemplos van desde marcar el uso de la “e” del lenguaje incluyente como un error o adelgazar los cuerpos de las mujeres al editar imágenes, hasta discriminar en las ofertas laborales que se muestran a los usuarios en redes sociales.

Este año, la Organización de las Naciones Unidas (ONU) destacó el tema de la violencia digital en el marco del 25 de noviembre, Día Internacional de la Eliminación de la Violencia contra las Mujeres. Las expertas recuerdan que la IA también reproduce activamente las violencias estructurales y las desigualdades.

También lee: ¿Por qué las mujeres marchan cada 25 de noviembre? Este año exigen acciones contra la violencia digital.

La IA reproduce estereotipos de género

Marcela Hernández sugiere a El Sabueso darle a algún modelo de inteligencia artificial la siguiente indicación: “¿Puedes generar la imagen de una persona exitosa?”.

“Es muy común que arroje imágenes de un hombre en traje, un hombre blanco”, adelanta.

El Sabueso realizó este ejercicio con ChatGPT y el resultado fue un hombre con traje, de piel blanca y complexión delgada.

Al mismo tiempo, cada vez es más común el uso de avatares —personajes digitales— de presentadoras de noticias generados con inteligencia artificial. La mayoría reproduce estereotipos de belleza: mujeres delgadas, con facciones finas, pelo lacio, largo y, algunas, incluso con escote.

En la siguiente imagen se pueden ver a cuatro presentadoras de canales de noticias de diferentes países generadas con IA:

“Las decisiones que toma la IA sobre los modelos de belleza no son solo técnicas, es una decisión sociotécnica. ¿Quién participó en el etiquetado y la selección de datos y cómo influyó en ese proceso?”, cuestiona Tatiana Revilla y señala que, aunque se esperaría que la tecnología ayude a eliminar las brechas de desigualdad, muchas veces termina reforzándolas.

Además de los estereotipos físicos, cuando se usan modelos de inteligencia artificial en procesos de empresas también pueden reforzarse desigualdades en el mundo laboral.

Por ejemplo, Reuters reportó en 2018 que Amazon tuvo que desechar un sistema de contratación que utilizaba IA porque favorecía a candidatos hombres. Esto ocurrió porque el modelo había sido entrenado con diez años de historial de contratación en donde la mayoría eran hombres, debido al dominio masculino en esa industria. Por lo tanto, el sistema repitió ese sesgo como una preferencia.

En 2022 un grupo de mujeres conductoras denunció que Facebook favorecía los anuncios de empleo hacia hombres y excluía a mujeres, por ejemplo, en ofertas para conductoras de camión. Ese mismo año, tras un acuerdo con el Departamento de Justicia de Estados Unidos, Meta aceptó eliminar las herramientas publicitarias que permitían esa discriminación laboral.

Tatiana Revilla enlistó otras áreas en donde ya se utiliza la IA y en las que se pueden repetir sesgos: sistemas que realizan diagnósticos médicos, máquinas que predicen riesgos de comportamiento para prevenir delitos o modelos de evaluación de desempeño en recursos humanos.

¿Cómo lograr sistemas de IA con perspectiva de género?

Las especialistas consultadas por El Sabueso coinciden en que la tecnología requiere mayor presencia de las mujeres para que tenga perspectiva de género y que, a su vez, existan políticas públicas que la refuercen.

“Creo que tiene que haber una intención voluntaria y articulada de apropiarse de las tecnologías y de los espacios digitales por parte de las mujeres, diversidades genéricas, poblaciones rurales, poblaciones afrodescendientes. Es decir, que el mundo digital nos lo podamos apropiar todas y todos”, asegura Marcela Hernández.

Esto implica desde mayor participación de mujeres en el desarrollo de nuevas tecnologías hasta publicar y difundir contenido que fomente la equidad y la justicia social.

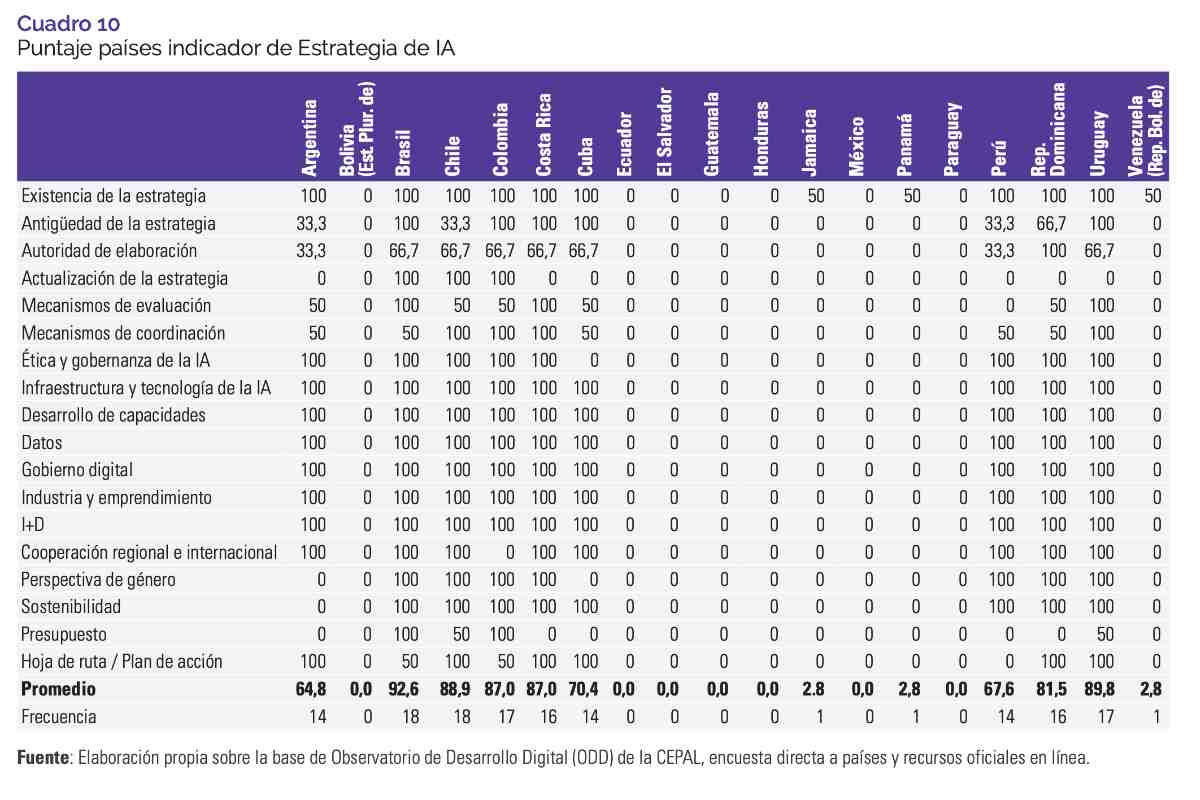

“Primero hay que reforzar las políticas públicas”, sostiene Tatiana Revilla. La experta añade que México debe contar con una política pública y una estrategia nacional de inteligencia artificial que integre la perspectiva de género.

Por ejemplo, se pueden aplicar auditorías algorítmicas, las cuales evalúan cómo se diseñan, entrenan y ajustan los algoritmos. También, exigir pruebas de desigualdad y transparencia algorítmica.

Hasta el momento, en México no existe una legislación que regule la inteligencia artificial.

El Índice Latinoamericano de Inteligencia Artificial 2025 evaluó a 19 países según su estado de avance de IA y colocó a México en el octavo lugar. El estudio analiza, entre otros aspectos, si las estrategias nacionales de IA incorporan una perspectiva de género; sin embargo, señala que México ni siquiera cuenta con dicha estrategia.

Para saber más: Algoritmos, desigualdad y calificación cero para México.

Tatiana Revilla invita a dejar de ver la regulación en inteligencia artificial como un tema técnico y, por el contrario, observarla como un tema social.